本文目录导读:

- 引言

- 1. 什么是Stable Diffusion?

- 2. Stable Diffusion的发展历程

- 3. Stable Diffusion的应用场景

- 4. Stable Diffusion的挑战与争议

- 5. 未来展望

- 结语

近年来,人工智能(AI)在图像生成领域取得了令人瞩目的进展,其中Stable Diffusion无疑是最具影响力的技术之一,作为一种基于深度学习的文本到图像(Text-to-Image)生成模型,Stable Diffusion不仅能够根据用户的文字描述生成高质量的图像,还在开源社区和商业应用中引起了广泛关注,本文将深入探讨Stable Diffusion的技术原理、发展历程、应用场景以及未来趋势,帮助读者全面了解这一革命性的AI技术。

什么是Stable Diffusion?

Stable Diffusion是由Stability AI公司开发的一种扩散模型(Diffusion Model),它能够根据自然语言提示(Prompt)生成高度逼真的图像,与传统的GAN(生成对抗网络)不同,Stable Diffusion采用了一种称为潜在扩散模型(Latent Diffusion Model, LDM)的技术,使得图像生成过程更加高效和可控。

1 扩散模型的基本原理

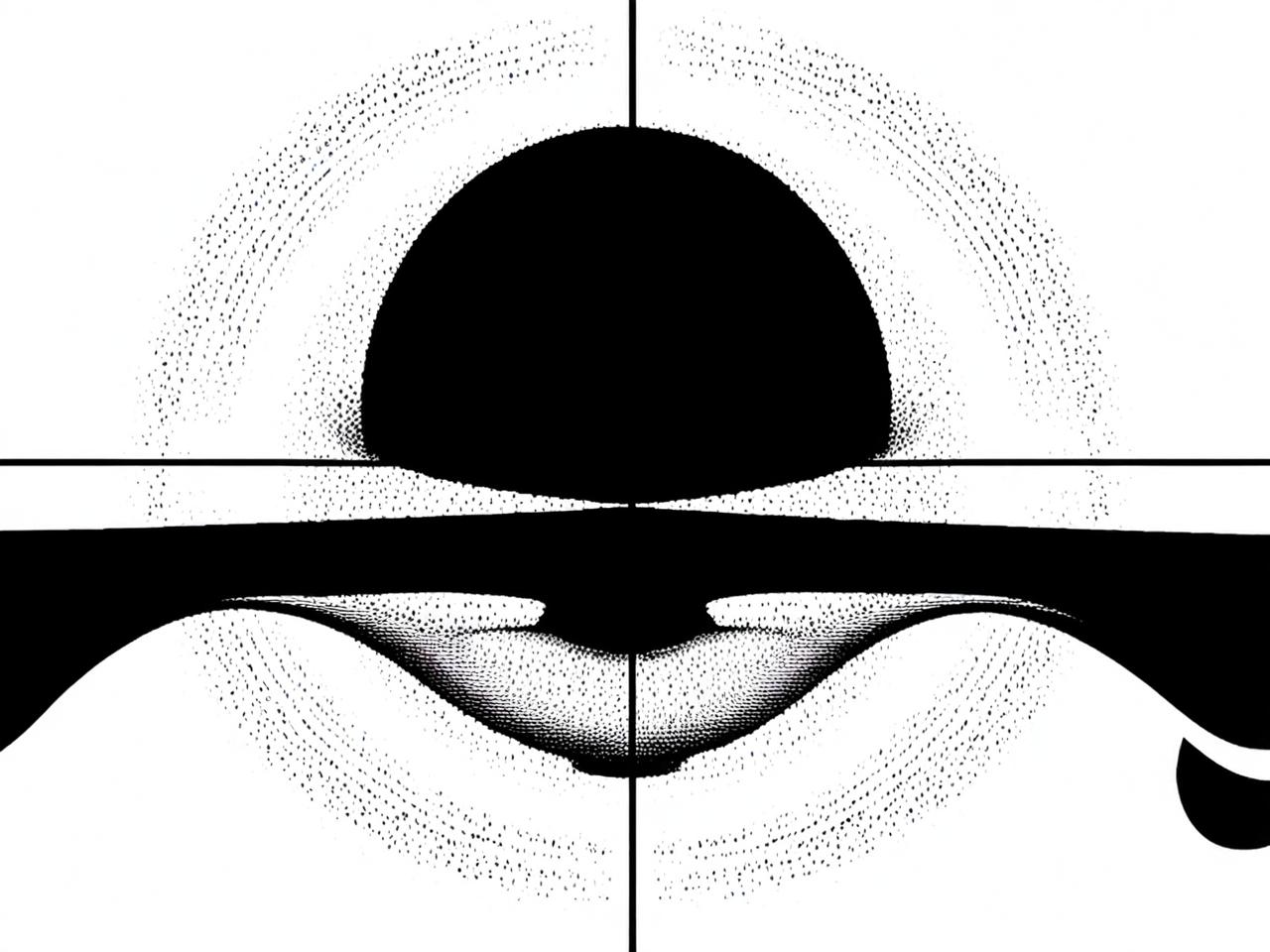

扩散模型的核心思想是通过逐步添加噪声(正向扩散)和去除噪声(反向扩散)来生成图像。

- 正向扩散:将一张真实图像逐步加入噪声,直到变成完全随机的噪声图。

- 反向扩散:通过训练神经网络,学习如何从噪声中还原出原始图像。

Stable Diffusion在此基础上进行了优化,它首先将图像压缩到一个低维的潜在空间(Latent Space),再在这个空间中进行扩散和去噪,从而大幅降低了计算成本。

2 Stable Diffusion的特点

- 开源免费:Stable Diffusion的代码和预训练模型向公众开放,任何人都可以下载并使用。

- 高效性:相比其他AI绘画模型(如DALL·E 2),它可以在普通消费级GPU上运行。

- 高度可控:用户可以通过调整提示词(Prompt)、负向提示(Negative Prompt)和采样参数来优化生成效果。

Stable Diffusion的发展历程

Stable Diffusion的诞生并非偶然,而是AI图像生成技术长期发展的结果,以下是几个关键节点:

1 从GAN到Diffusion Model

- GAN(2014):由Ian Goodfellow提出,通过生成器和判别器的对抗训练生成图像,但存在训练不稳定、模式崩溃等问题。

- VAE(2016):变分自编码器(VAE)能够生成图像,但质量不如GAN。

- Diffusion Model(2020):由Jonathan Ho等人提出,通过逐步去噪的方式生成高质量图像,但计算成本极高。

2 Stable Diffusion的诞生(2022)

2022年8月,Stability AI联合CompVis和Runway ML发布了Stable Diffusion 1.0,并迅速成为开源AI绘画领域的标杆,随后,Stable Diffusion 2.0、XL等版本陆续推出,进一步提升了图像质量和生成效率。

Stable Diffusion的应用场景

由于其强大的生成能力,Stable Diffusion已在多个领域得到广泛应用:

1 艺术创作与设计

- 数字绘画:艺术家可以使用AI快速生成概念图,提高创作效率。

- 游戏与影视:用于角色设计、场景构建等,降低制作成本。

2 广告与营销

- 个性化广告:根据用户偏好生成定制化视觉内容。

- 社交媒体创作者快速生成吸引眼球的图片。

3 教育与科研

- 数据增强:生成合成数据用于机器学习训练。

- 科学可视化:辅助科研人员展示复杂概念。

4 商业与工业

- 产品设计:快速生成产品原型图。

- 虚拟试衣:在电商领域提供AI换装功能。

Stable Diffusion的挑战与争议

尽管Stable Diffusion带来了巨大的创新,但也面临一些争议:

1 版权与伦理问题

- 数据来源争议:Stable Diffusion的训练数据包含大量未经授权的艺术作品,引发版权纠纷。

- 深度伪造风险:可能被用于生成虚假图片或恶意内容。

2 技术局限性

- 细节控制不足:复杂场景下可能出现逻辑错误(如多手指、扭曲人脸)。

- 计算资源需求:虽然比传统Diffusion Model高效,但仍需高性能GPU支持。

未来展望

随着技术的进步,Stable Diffusion的未来可能朝以下方向发展:

- 更精准的控制:结合ControlNet等技术,实现更精细的图像编辑。

- 3D与视频生成:扩展至动态内容生成,如AI动画、电影特效。

- 商业化应用:更多企业将整合Stable Diffusion,推动AI内容创作产业化。

Stable Diffusion代表了AI图像生成技术的一次重大飞跃,它不仅降低了创作门槛,也为各行各业带来了新的可能性,尽管仍存在挑战,但其开源特性、高效性和灵活性使其成为当前最具潜力的AI工具之一,随着技术的不断优化,Stable Diffusion有望进一步改变我们的视觉世界。